はじめに

学期が始まっているっていうのに,まだ春休みモードで今すぐにやらなくてもいいことが捗ってしまっている田村です。

少し前に,Claude CodeやChatGPTを使って論文を丸ごと書くワークフローを紹介するX上の記事をいくつか目にしました。その中には「AIが書いた文章のAI臭さを消すツール(Humanizer)」を強く推奨しているものもあって,正直なところ,うーん…となりました。

AI臭さを「消す」ことが前提になっている時点で,それはもう「AIが書いた論文をAIが書いたとバレないようにする」ワークフローなわけで,なんでそんなものにみんな群がっているのだろうかと。学術倫理的にかなり危ういですよね。

じゃあどうするのか

同僚の水本篤先生が,「生成AIを用いた倫理的・効率的な英語論文執筆」という非常に体系的なWebガイドを公開されています。このガイドは「隠す」のではなく「適切に使って,ちゃんと申告する」という思想で設計されていて,Augmented Competence(AIで拡張できる能力の範囲)の原則や,AI利用の倫理的な判断基準が明確に示されています。

このガイドでは,使えるプロンプトも豊富に掲載されているのですが,論文を書いている作業の中で,あの水本先生のガイドの中のプロンプトを使おうって思っても,探しに行くのに手間取ってしまったり,気づいたら水本先生のXのポストを見に行ってしまって時間を空費してしまう可能性もありますよね。そこで,ガイドの原則をClaude上で自動的に適用できるようにスキル化したら便利じゃないかと思い,水本先生の許可をいただいた上で作りました。

ethical-academic-writing

GitHub: https://github.com/tam07pb915/ethical-academic-writing

日本語版と英語版の両方を用意しています。詳しくはGitHub上のREADMEやそれぞれのマークダウンファイルをお読みいただければと思いますが,簡単にこの記事でも紹介します。

何ができるか

- 倫理ガードレール:受容能力の範囲内での支援に限定。「自分では書けない表現は使わない」を自動チェック

- AI生成文で目立ちやすい表現への注意喚起:一律禁止ではなく,不必要な反復を点検

- 8つの失敗パターン検出:AI丸投げ,架空引用,文体キメラ(文体のツギハギ状態)などを警告

- 3段階の洗練プロセス:内容の英語化→文体調整→表現の磨き上げ

- セクション別テンプレート:CARSモデル(Introduction),ムーブ分析(Discussion),APA統計書式(Results)など

- AI利用申告の自動生成:使用状況に応じた5段階のテンプレート

- 査読対応:模擬査読,Response to Reviewers,カバーレター支援

何をしないか

- 本文の丸ごと生成(ユーザーの骨格が必要)

- 文献・引用・DOIの生成

- AI検出回避を目的とした書き換え

要するに,AIに「論文を書かせる」のではなく,「自分が書いた論文をAIで診断・洗練する」ために,生成AIに読み込ませる指示書ファイル群です。

使い方

claude.aiのProjectに入れて使うのがおすすめです。論文執筆用のProjectを作って,SKILL.mdをProject Instructionsに貼り,references/のファイルをProject Knowledgeとしてアップロードするだけです。

Claudeの用途がほぼ論文執筆だけの人は,ユーザースキルとしてインストールして全会話に適用してもいいと思います。

私はいつも,Claude Code使おうかなってClaudeに相談すると,「あなたの用途なら全然必要ない。」って言われていまだにclaude.aiとCoworkしか使っていないのですが,Claude Codeの場合は ~/.claude/skills/ にフォルダごとコピーすればOKのようです。

作る過程で面白かったこと

このスキル自体は,水本先生のウェブガイドをソースにしてClaudeに作らせました。ところが,最初のバージョンで参考文献の書誌情報が間違っていました。Kobak et al. (2025) のタイトルが不正確だったり,Mizumoto et al. (2024) のDOIパスの一部を論文タイトルだと誤認していたりという。私が見ていたら,参考文献がなんか怪しそうだなと気づき,調べてみたら誤りだと気づきました。「文献はAIに生成させるな」「DOIは必ず検証しろ」とスキル自身が書いているのに,スキルを作ったAI自身が(というか私がといってもいいんですが)それをやっている。なかなか皮肉な話です。これは他にもありそうだなと思って,ChatGPTにファクトチェックさせたらそっちも著者名を間違えていたので(実在する筆頭著者+架空の共著者という部分捏造型ハルシネーション),最終的にCrossrefで検証して修正しました。

この経験自体が,水本先生のガイドが言っている「AIの出力を無批判に採用しない」「ファクトチェックは人間がやる」の重要性を実証しているなと思って,ちょっとだけ肝が冷えました。最近,論文を書くときに先行研究のレビューでこんなことやってるor言ってる研究ないかなとGeminiのDeep Research使って調べてもらったのですが,自分がよく読んだことのある論文に「XXXX」という直接引用があってこれがまさにあなたが知りたかったことですよね,みたいなレポートを出してきたんですよ。「おまえ自分では(アクセスできないから)ほとんどの論文のアブストしか読めないくせにそんな自信満々に書いてきて胡散臭いぞ」と思って論文の中身を検索したら全然そんなことは書いてありませんでした。ということもありました。Xのおすすめとかは私が興味あることもあって割とAIすげえええみたいなのとか,研究への利用の話も流れてくるのですが,冒頭で私が言及した記事とかもマジでありえん話でしたし,ほんとXは140字でも胡散臭いのたくさんあったのに長文記事は長く書いてある文だけ信憑性がありそうな雰囲気が漂っていて,マジでひどいです。長文記事も長文ポストも,途中まで読んでAI臭がしてだめだってなるの多いですよねほんとに。あれ,なんか脱線して愚痴っぽくなってしまいました。

おわりに

私的には,AIを論文執筆に使うこと自体は止められない流れだと思います。だからこそ,「隠す」方向ではなく「ちゃんと使って申告する」方向でやっていかないといけないなと感じていますし,でもかといってまだまだ試行錯誤の真っ只中でもあるので,あれこれ試しながら,自分にあった方法も使いながらって感じでやってます。ブログ記事も,生成AIに整えてもらうことはあるんですが,それで自分らしさがなくなっちゃっちゃーいやよね,とか思ったりもしました。

そこで,私は自分が2012年からやってるこのブログの全記事をxmlファイルでダウンロードして,それをマークダウンファイルに変換してNotebookLMに読ませて文体の分析をさせました。それをClaudeにスキル化してもらって,最終的に私らしさが失われないようにチェックしてもらうようにしようかなとか思っています。

私はまあ数は多くないですが,生成AI登場以前も論文を書いたことがあるので,それを使って自分の論文のスタイルとかロジックとかの「クセ」をNotebookLMに抽出してもらって,生成AIとやりとりしながら作った文章が,過去の自分の書いた論文とズレがないかをチェックしてもらうみたいなのも同じ発想でできそうですよね。

おわりにとかいって全然終わらせる気がない感じになってしまいましたが,水本先生のガイド(https://langtech.jp/ai-writing/)は本当によくできているので,スキルを使うかどうかに関わらず,一度目を通すことをおすすめします。

なにをゆう たむらゆう。

おしまい。

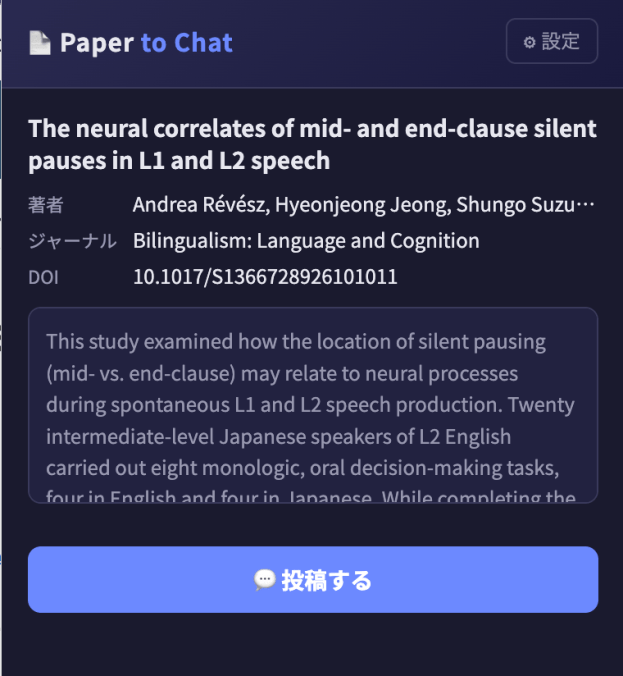

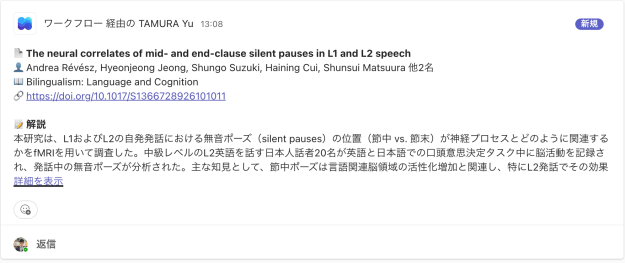

追記(2026-04-14)

使い方について訂正

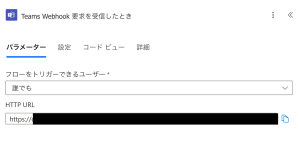

上で「claude.aiのProjectに入れて使うのがおすすめです」と書いたのですが,実際にやってみたら全然制御が効きませんでした。

Project InstructionsにSKILL.mdを貼って,referenceファイル(プロンプトテンプレート集やチェックリスト)をProject Knowledgeにアップロードする方法だと,Claudeがreferenceファイルを「必要」と判断したときしか読みに行かないので,せっかく作ったテンプレートやチェックリストがまったく参照されないことがありました。

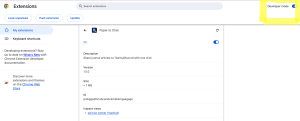

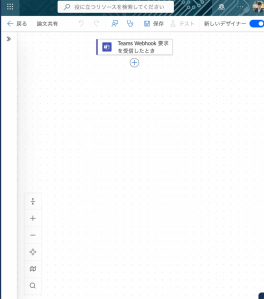

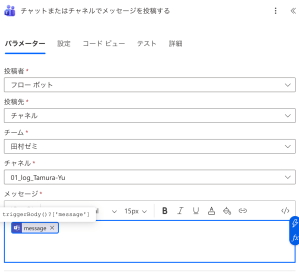

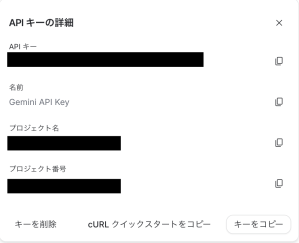

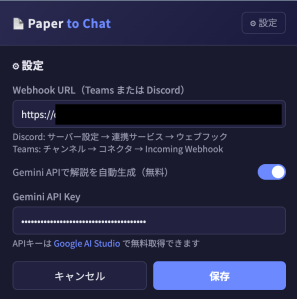

現在の推奨はカスタムスキルとしてのアップロードです。

- GitHubからZIPでダウンロード

- claude.aiで Settings > カスタマイズ に移動(現行ではコネクタにいくと,カスタマイズへの移動を促されます)

- カスタマイズの中の「スキル」を選択

- +ボタンでスキルを作成を選択し,

- 「スキルをアップロード」を選んでZIPをアップロード

これでスキルのdescriptionに基づいてClaudeが自動判断で読み込むようになります。「論文の英語を直して」とか「査読コメントへの返事を書きたい」みたいな依頼をすると勝手に効きます。効いてないなと思ったり,「ここで呼び出そう!」みたいなタイミングがあったら意図的にスキル呼び出すのもいいと思います。

なお,Claude Codeの場合は ~/.claude/skills/ にフォルダごとコピーすれば,/ethical-academic-writing のようにスラッシュコマンドで明示的に呼び出すこともできます。

文体チェックスキルの話

「おわりに」で書いた,ブログの文体分析→自分らしさのチェックの話ですが,実際にスキルとして実装しました(こちらは個人用で非公開)。

やったことは以下のとおりです。

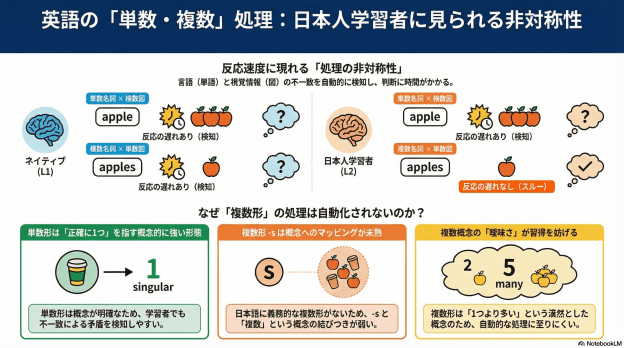

- ブログの全記事XMLをマークダウンに変換してNotebookLMに読ませ,文体の特徴を抽出

- 論文の方も,自分の単著・筆頭論文のPDFをNotebookLMに読ませて,語彙・文構造・論理展開の3層で特徴を抽出

- 抽出結果をプロファイルとしてまとめて,ドラフト完成時にプロファイルとの乖離をチェックするスキルを作成

論文用のプロファイルでは,たとえば「mightをmayより好む」「Looking at Table X, … でデータを参照する癖がある」「Limitationsは率直に認めた上で”In spite of these limitations, the study does add to…”で締める」みたいな自分のクセが抽出されていて,ちょっと面白かったです。AIで推敲した後にこういう個性が消えていないかを点検する,という使い方をしています。

ポイントは,プロファイルは「正解」ではなく「ベースライン」だということです。乖離が見つかったとしても,それが意図的な改善なのか,AIに引きずられた無自覚な変化なのかは自分で判断します。voiceチェックでフラグが立ったら即修正しないとけないというわけではなくて,あくまで自分では見逃してしまっていた箇所がないかということを確認するためのツールです。

更新履歴

- 2026-04-13(初版公開):スキルの紹介,使い方(Project方式),ファクトチェックの失敗談

- 2026-04-14(追記):使い方をProject方式からカスタムスキル(ZIPアップロード)に変更(Project方式ではreferenceファイルが参照されない問題が判明)。文体チェックスキルの実装報告